Environ 12 pour cent des propositions Horizon Europe soumises en 2025 recevront un financement, et l’évaluation intermédiaire de la Commission européenne reconnaît elle-même que près de sept candidatures de haute qualité sur dix échouent non pas par manque de mérite, mais parce que le programme manque d’environ 82 milliards d’euros pour financer tout ce qui obtient une note supérieure au seuil de qualité. C’est cette arithmétique brutale qui encadre toute discussion sur les subventions européennes pour la recherche et l’innovation. Elle comporte aussi une conséquence utile pour toute personne préparant une proposition : franchir le seuil est nécessaire, mais ne suffit plus. Les propositions qui sont effectivement signées ne sont pas simplement celles qui évitent les erreurs. Ce sont celles dont la structure, le langage et la logique interne rendent le travail de l’évaluateur simple, rapide et exempt de doute.

Cet article examine la véritable anatomie d’une proposition Horizon Europe financée dans le cadre des programmes de travail 2026-2027, section par section, et identifie les choix structurels qui distinguent les propositions financées de celles qui sont seulement finançables.

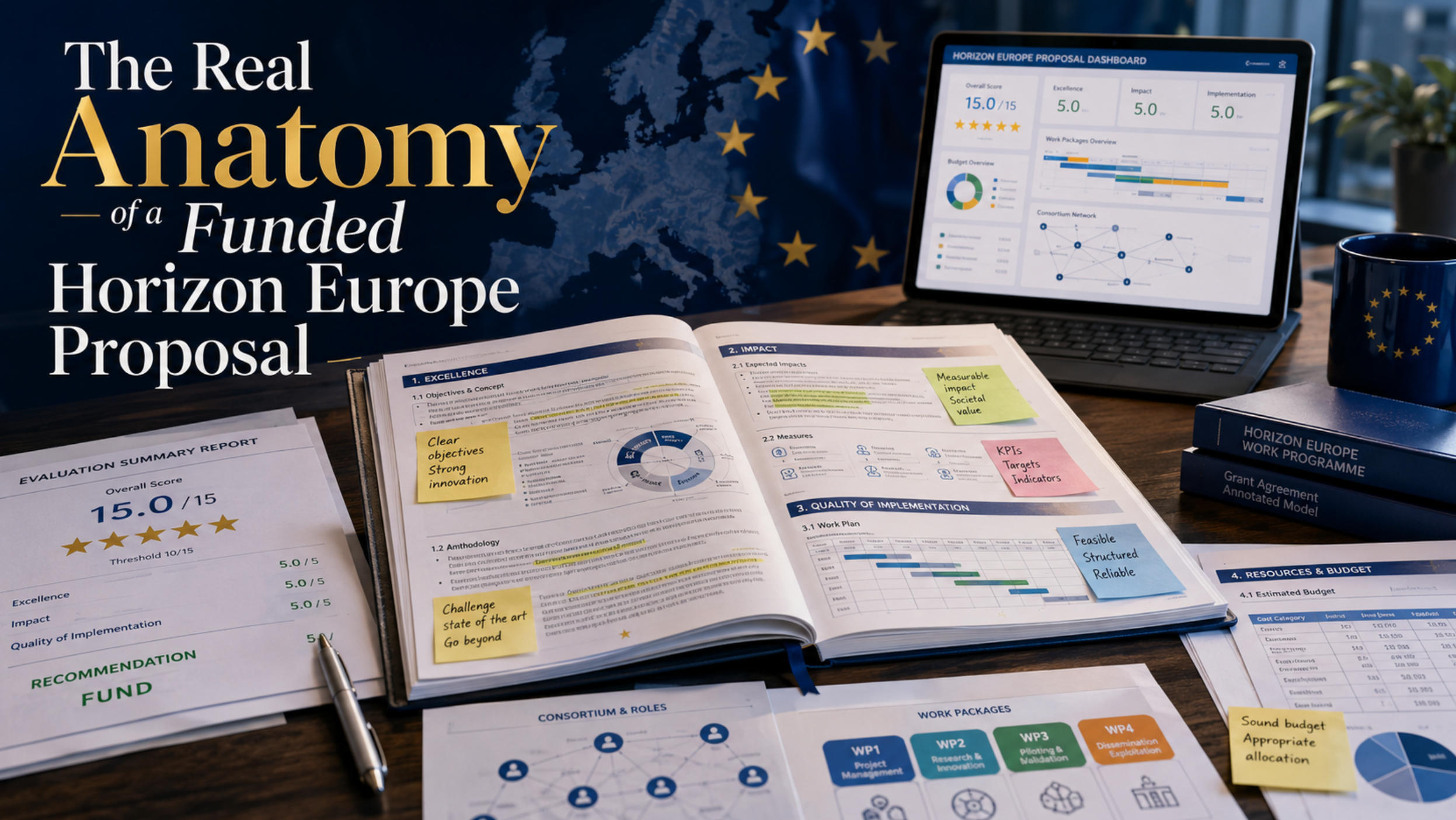

L’architecture : Partie A, Partie B et les trois critères

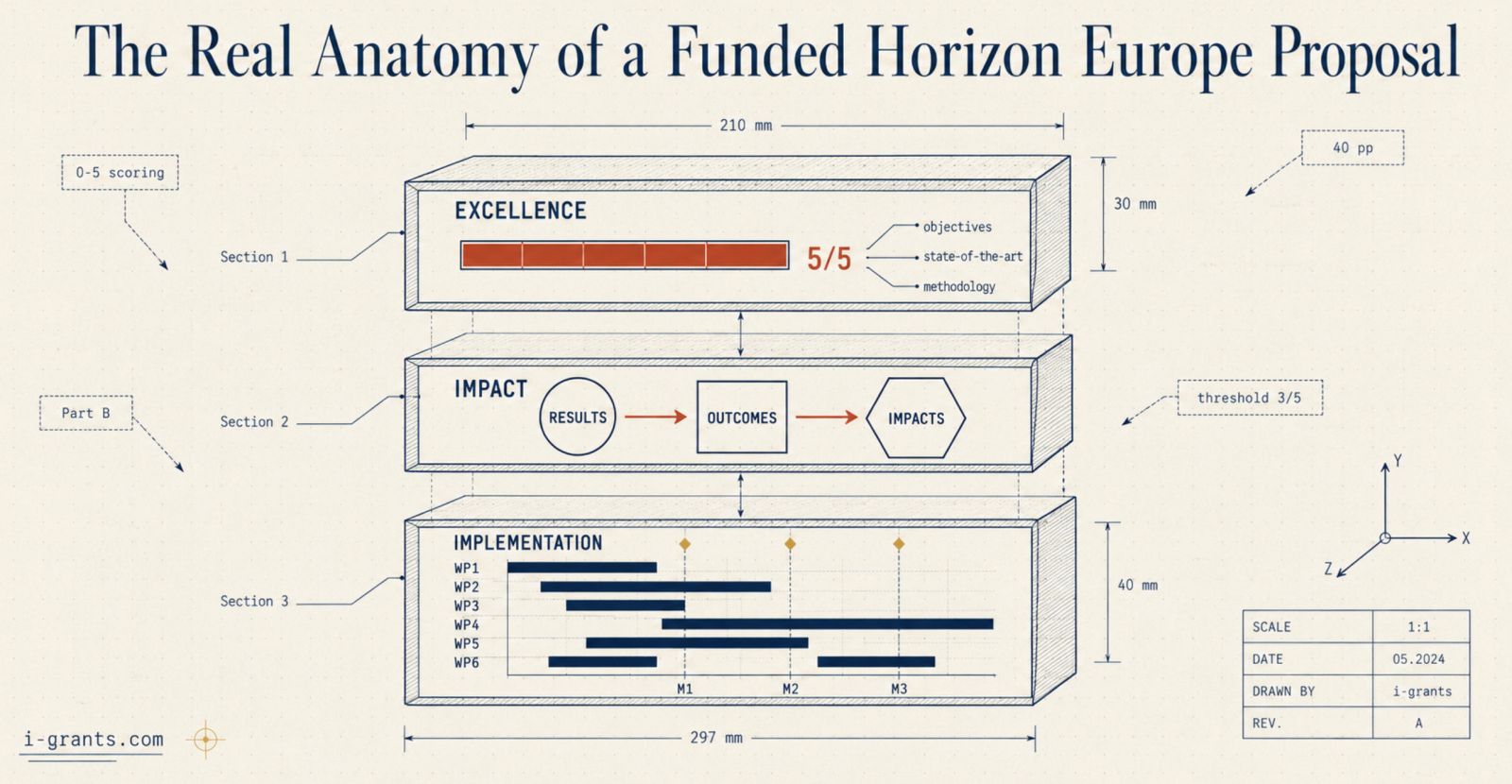

Une proposition Horizon Europe comporte deux parties, et seulement deux. La Partie A correspond aux formulaires administratifs générés par le portail Funding and Tenders : titre, résumé, identifiants des partenaires, tableaux budgétaires, auto-évaluation éthique, auto-évaluation de sécurité, déclarations. La majeure partie de la Partie A est constituée de données structurées, et peu d’éléments peuvent y être reformulés de manière persuasive. La Partie B est le récit au format PDF, et c’est là que la proposition gagne ou perd réellement. Selon les modèles révisés 2026-2027 publiés par la Commission européenne en décembre 2025, la Partie B pour les Research and Innovation Actions et les Innovation Actions est limitée à 40 pages, ou à 45 pages si le sujet utilise le financement en lump sum. Les Coordination and Support Actions sont limitées à 25 pages. Tout ce qui dépasse la limite est ignoré par les évaluateurs ; la coupure est automatique, non négociable.

La Partie B est divisée en trois sections qui correspondent directement aux trois critères d’évaluation : Excellence, Impact, et Qualité et efficacité de la mise en œuvre. Chaque critère est noté de 0 à 5 par des évaluateurs experts indépendants, avec un seuil de 3 sur 5 pour chaque section et un total minimal de 10 sur 15. Les trois critères ont le même poids pour les Research and Innovation Actions, mais pour les Innovation Actions, le critère Impact reçoit une pondération de 1,5 dans la formule de classement. Cela signifie que, pour les travaux à niveau de maturité technologique plus élevé, la deuxième section est véritablement la partie la plus importante de tout le document.

La structure de la Partie B est fixée par le modèle et ne peut être ni réorganisée ni renommée. Ce qui peut changer, c’est le contenu de chaque sous-section, et c’est précisément là que les propositions financées se distinguent des propositions rejetées.

Section 1, Excellence : la différence entre intéressant et ambitieux

La section Excellence pose trois questions dans l’ordre : ce que le projet cherche à atteindre, pourquoi il est ambitieux au regard de l’état de l’art actuel, et dans quelle mesure l’approche méthodologique est solide. Les évaluateurs voient des centaines d’introductions du type « nous proposons une méthode nouvelle pour répondre à un défi important » et les traitent comme du bruit de fond. Une section Excellence financée commence par une affirmation spécifique et falsifiable. Non pas « nous améliorerons la précision diagnostique en imagerie oncologique », mais quelque chose de plus proche de : « nous démontrerons qu’une architecture d’apprentissage fédéré entraînée dans sept réseaux hospitaliers européens peut réduire le taux de faux négatifs dans le dépistage du cancer du pancréas à un stade précoce de 31 pour cent, qui est la norme actuelle, à moins de 15 pour cent sur un jeu de test indépendant de 12 000 scans anonymisés, en faisant passer le projet du TRL 4 au TRL 6 en 42 mois ».

Cette phrase accomplit plusieurs choses à la fois. Elle dit ce qui sera vrai à la fin. Elle nomme l’indicateur. Elle quantifie la situation de référence. Elle déclare la trajectoire TRL. Elle implique l’échelle de preuve requise. Les évaluateurs qui notent ce paragraphe selon la grille Excellence ont quelque chose à évaluer. Le même contenu formulé comme une déclaration de mission générique ne leur donne rien à évaluer, ce qui explique pourquoi il obtient souvent une note entre 2,5 et 3,5, suffisante pour rejeter une proposition pour des raisons budgétaires même si la science est réellement bonne.

Le traitement de l’état de l’art est le deuxième endroit où les notes d’Excellence divergent fortement. Les propositions faibles énumèrent la littérature adjacente et affirment que leur approche est « nouvelle ». Les propositions financées identifient une lacune précise, nomment les principales approches qui n’ont pas réussi à la combler, expliquent pourquoi elles ont échoué et situent leur propre contribution à l’intérieur de cette lacune. Les références doivent être récentes, avec une majorité datant des trois à cinq dernières années, inclure des sources académiques et industrielles lorsque cela est pertinent, et mentionner tout projet Horizon 2020 ou Horizon Europe antérieur dont le consortium exploite les résultats. La base CORDIS est le bon endroit pour vérifier ce qui a déjà été financé dans des domaines proches ; l’ignorer produit une section Excellence que les évaluateurs liront comme mal informée ou stratégiquement vague.

La méthodologie est le point où les attentes des évaluateurs divergent entre Innovation Actions et Research and Innovation Actions. Les Research and Innovation Actions aux TRL 2 à 6 doivent démontrer une rigueur scientifique : structure des hypothèses, contrôles, puissance statistique, plans de réplication, gouvernance des données. Les Innovation Actions aux TRL 6 à 8 doivent démontrer une rigueur d’ingénierie et de validation : sélection des sites pilotes, protocoles de démonstration, comparateurs, méthodologie de test auprès des utilisateurs finaux. Dans les deux cas, ce qui déclenche une note élevée est la capacité de la section méthodologie à répondre à la question qu’un évaluateur sceptique poserait s’il cherchait le point faible de la proposition. Les propositions financées anticipent cette question et y répondent explicitement.

L’interdisciplinarité est de plus en plus une exigence plutôt qu’une option. Les programmes de travail 2026-2027 intègrent des attentes en sciences sociales et humaines dans la plupart des clusters, en particulier le Cluster 1 Santé, le Cluster 5 Climat, énergie et mobilité, et le Cluster 6 Alimentation et bioéconomie. Une proposition qui nomme un partenaire en sciences humaines ou sociales mais lui attribue un effort symbolique et aucune responsabilité de work package sera pénalisée pour tokenisme. Une proposition qui intègre réellement cette expertise, par exemple en confiant à une équipe de sciences comportementales la responsabilité d’un work package de co-conception dont les résultats alimentent ensuite le flux de travail technique, obtiendra des points sur une dimension que les consortiums purement techniques laissent souvent de côté.

Section 2, Impact : le cheminement, pas la promesse

Le plus grand changement entre Horizon 2020 et Horizon Europe, et le changement structurel qui distingue le plus souvent les propositions financées des propositions rejetées en 2026, est le passage des déclarations d’impact génériques au cadre des Key Impact Pathways. Horizon Europe définit l’impact selon trois dimensions, scientifique, sociétale, économique et technologique, chacune étant divisée en trois cheminements, pour un total de neuf. Une section Impact financée aborde les dimensions pertinentes pour son sujet, et non les neuf à tout prix, et le fait au moyen d’une chaîne causale structurée : d’abord les résultats, ensuite les outcomes, puis les impacts.

La distinction entre ces trois termes est désormais appliquée avec rigueur par les évaluateurs. Les résultats sont les productions immédiates et tangibles du projet : un prototype, un jeu de données, une ligne directrice, une cohorte formée. Les outcomes sont ce qui change pour les groupes cibles directs pendant ou peu après le projet : adoption par un organisme de réglementation particulier, déploiement dans un segment industriel spécifique, intégration dans la pratique clinique sur des sites nommés. Les impacts sont les évolutions sociétales, économiques ou environnementales à plus long terme auxquelles les outcomes contribuent : réduction des émissions dans un secteur, amélioration de la survie dans une population de patients, baisse des coûts dans un service public. Les propositions qui confondent ces trois niveaux, et beaucoup le font, perdent un point entier sur l’Impact, ce qui, dans une compétition serrée, suffit à les faire passer sous la ligne de financement.

Ce que les évaluateurs veulent voir en 2026, c’est un cheminement plausible étape par étape. La plausibilité implique des situations de référence, c’est-à-dire où nous en sommes maintenant, des benchmarks, c’est-à-dire ce qui compte comme succès à chaque étape, et des hypothèses, c’est-à-dire ce qui doit être vrai en dehors du projet pour que le cheminement tienne. Elle implique aussi des parties prenantes nommées. « Partenaires industriels » est vague. « Fournisseurs automobiles de rang 1 basés en Allemagne, en France et en Italie, qui contrôlent collectivement 62 pour cent du marché européen du composant concerné » est spécifique et crédible. Les propositions financées obtiennent des lettres d’intention ou de soutien de la part d’utilisateurs finaux nommés et font référence à ces lettres dans la section Impact, et pas seulement dans l’annexe.

Les mesures de dissémination, d’exploitation et de communication, souvent abrégées en DEC, étaient autrefois l’endroit où les candidats remplissaient les pages avec des conférences, des sites web, des plans de réseaux sociaux et des objectifs de publication scientifique. Dans le modèle 2026, les limites de pages sont plus strictes et les orientations prescriptives sont réduites, ce qui signifie que les évaluateurs lisent les catalogues DEC avec davantage de scepticisme. Une section DEC financée identifie un ou deux canaux principaux par groupe de parties prenantes, relie chaque activité à un outcome spécifique qu’elle fait progresser, et traite l’exploitation comme un véritable plan commercial ou politique plutôt que comme une liste d’intentions. Lorsque la commercialisation fait partie de la voie vers l’impact, un modèle économique crédible est attendu même au stade du prototype. Lorsque l’adoption politique est la voie choisie, des processus politiques nommés, comme un cycle précis de révision d’une directive européenne ou le renouvellement d’une stratégie nationale particulière, ont beaucoup plus de poids qu’une référence générique à « l’information de la politique européenne ».

La section Impact doit également répondre à deux exigences qui proviennent d’autres domaines de la stratégie européenne. La première est la science ouverte : chaque projet Horizon Europe doit s’engager à garantir l’accès ouvert aux publications évaluées par les pairs au titre de l’article 17 de la convention de subvention, et un aperçu du Data Management Plan est attendu dans la proposition, avec un DMP complet à fournir six mois après le début du projet. La deuxième est l’obligation de discuter des variables de sexe et de genre dans la recherche elle-même lorsque cela est scientifiquement pertinent, en particulier dans la santé, les sciences sociales et toute conception technologique qui interagit avec des populations diverses. Ce n’est pas la même chose que l’équilibre de genre dans l’équipe, qui relève d’un autre aspect ; il s’agit de savoir si la recherche elle-même est méthodologiquement robuste pour l’ensemble de la population qu’elle prétend servir.

Section 3, Mise en œuvre : là où les évaluateurs cherchent des raisons de douter

La section Mise en œuvre est la partie de la proposition où l’on ne demande plus aux évaluateurs de croire, mais de vérifier. L’architecture est fixe : un plan de travail, une description du consortium et une justification des ressources. Une section Mise en œuvre financée organise son travail en six à dix work packages, presque toujours avec un work package consacré à la gestion du projet et un autre à la dissémination, l’exploitation et la communication. Moins de six work packages tend à donner l’impression d’une structure insuffisante pour un projet de trois à quatre ans consommant trois à six millions d’euros, la fourchette typique d’une Research and Innovation Action. Plus de dix donne souvent l’impression d’un projet fragmenté et difficile à gouverner.

Chaque work package comporte au moins un jalon et un livrable, et dans la plupart des cas plusieurs de chaque. Les propositions financées tendent vers environ trois à cinq jalons pour l’ensemble du projet, et non par work package, car une fois la convention de subvention signée, ces jalons deviennent contractuels. Il en va de même pour les livrables : chaque livrable listé dans la proposition est une obligation juridique, et gonfler leur nombre pour paraître productif devient un problème de gestion de projet dès que la subvention est attribuée.

Un diagramme de Gantt est pratiquement obligatoire. Les évaluateurs n’ont pas le temps de reconstruire une chronologie à partir de la prose, et un calendrier visuel clair tenant sur une ou deux pages, avec les work packages, les tâches, les jalons et les livrables alignés sur un axe en mois de projet, est le moyen le plus efficace de communiquer que le projet est faisable. Les propositions financées incluent aussi souvent un diagramme PERT ou un schéma équivalent de dépendances montrant comment les work packages s’alimentent les uns les autres. Les évaluateurs l’utilisent pour vérifier si les work packages en aval disposent d’intrants réalistes provenant des work packages en amont.

La section risques, souvent traitée comme une réflexion secondaire, est l’endroit où de nombreuses propositions par ailleurs solides perdent un point. L’attente en 2026 est un registre structuré des risques techniques, organisationnels et externes, chacun avec une évaluation de probabilité, une évaluation d’impact et une mitigation spécifique liée à un work package ou à un partenaire. Les risques génériques, comme les éternels « retards de recrutement » ou « difficultés de communication au sein du consortium », accompagnés de mitigations génériques, obtiennent de mauvaises notes. Les risques spécifiques au projet, par exemple « l’approbation réglementaire du deuxième site pilote pourrait être retardée de six mois si l’autorité nationale exige des données de sécurité supplémentaires, ce qui entraînerait un retard en cascade dans la validation du WP5 », accompagnés de plans de contingence nommés, sont bien notés.

La description du consortium dans la section 3.3 est l’endroit où les propositions les plus solides font quelque chose de subtil. Plutôt que de copier les profils des partenaires depuis la Partie A, elles décrivent le consortium de manière fonctionnelle : ce que chaque partenaire apporte, pourquoi cette contribution est nécessaire, où se situe l’expertise qu’aucun autre partenaire ne fournit, et comment les rôles des partenaires se connectent. Les consortiums financés évitent deux échecs caractéristiques. Le premier est la décoration géographique, lorsque des partenaires sont ajoutés depuis certains États membres pour satisfaire un équilibre politique supposé sans rôle fonctionnel clair. Le second est le work package à partenaire unique, lorsqu’une organisation gère seule tout un work package, ce qui contredit la logique collaborative d’Horizon Europe et ressemble à une sous-traitance à peine déguisée. Chaque work package doit avoir un responsable clair et au moins deux ou trois partenaires contributeurs ayant des fonctions distinctes.

La justification des ressources traduit tout ce qui précède en euros. Les propositions financées présentent des allocations réalistes de person-months entre partenaires, le coordinateur assumant généralement davantage d’effort de gestion qu’un partenaire ordinaire, ce qui est attendu. Elles justifient les équipements et la sous-traitance en lien avec des tâches spécifiques et appliquent proprement le taux forfaitaire de 25 pour cent pour les coûts indirects. Les budgets qui répartissent l’effort de manière égale entre les partenaires, indépendamment de leurs rôles, constituent un signal d’alerte pour les évaluateurs et une raison fréquente de demandes de clarification lors de la préparation de la convention de subvention.

La logique de consortium que les évaluateurs appliquent réellement

Derrière chaque note de Mise en œuvre se trouve une question que l’évaluateur se pose silencieusement : si je devais parier que ce groupe exact d’organisations livrera ce plan de travail exact avec ce budget exact, est-ce que je parierais oui ? Le minimum collaboratif pour une Research and Innovation Action ou une Innovation Action est de trois entités juridiques indépendantes issues de trois États membres de l’Union européenne ou pays associés à Horizon Europe différents, mais le respect minimal des règles ne produit pas de notes élevées. Les propositions financées comptent généralement huit à quinze partenaires, calibrés selon l’ampleur du travail, avec une équipe centrale claire et un coordinateur crédible.

Le track record du coordinateur pèse de manière disproportionnée. Le portail Funding and Tenders et la base de projets CORDIS rendent visible l’historique de chaque coordinateur, et les évaluateurs le consultent effectivement. Un consortium dirigé par un coordinateur débutant sans expérience préalable des programmes-cadres n’est pas automatiquement rejeté, mais il exige des preuves compensatoires : un plan de gestion solide, un project officer expérimenté et, idéalement, un co-coordinateur ou un responsable scientifique ayant une expérience des programmes-cadres. La même logique s’applique aux pays widening, c’est-à-dire les États membres ayant une performance plus faible en recherche et innovation. Leur implication est encouragée par le programme, avec 58 pour cent des projets collaboratifs Horizon Europe comprenant désormais au moins un partenaire issu d’un pays widening. Mais un coordinateur issu d’un pays widening avec un track record limité a besoin d’un consortium plus solide autour de lui pour obtenir une note compétitive.

L’implication industrielle, lorsque le sujet de l’appel l’implique, est évaluée sur la substance plutôt que sur les logos. Une liste de petites et moyennes entreprises dans le consortium compte moins qu’un cheminement d’exploitation clair expliquant comment ces entreprises utiliseront commercialement les résultats. Les lettres de soutien d’utilisateurs finaux, qu’il s’agisse d’hôpitaux pour un projet de santé, d’opérateurs de réseau pour un projet énergétique ou de ministères pour un projet politique, ont du poids lorsqu’elles mentionnent des déploiements spécifiques plutôt qu’un intérêt générique.

Les questions transversales qui influencent silencieusement votre note

Les exigences transversales n’ont pas leur propre section, et c’est précisément pourquoi les propositions perdent des points à leur sujet. Le genre, l’éthique, la science ouverte, les données FAIR et l’intégration des sciences sociales et humaines sont notés à l’intérieur des trois critères principaux. Ne pas les traiter de manière substantielle fait baisser les notes en Excellence, pour la méthodologie, en Impact, pour la pertinence face aux défis sociétaux, et en Mise en œuvre, pour le consortium et les ressources. Une proposition qui ne mentionne ces questions que dans des sous-paragraphes dédiés semble guidée par la conformité. Une proposition qui les intègre dans la logique substantielle du projet paraît sérieuse.

La science ouverte mérite une attention particulière, car elle est désormais obligatoire et non plus aspirationnelle. L’aperçu du Data Management Plan dans la proposition doit préciser quels jeux de données seront ouverts, sous quelles licences, dans quels dépôts, comme Zenodo, OpenAIRE ou des plateformes propres à un domaine, et avec quelles normes de métadonnées. Les principes FAIR, Findable, Accessible, Interoperable, Reusable, doivent être mentionnés explicitement. Les propositions qui traitent le partage des données comme une contrainte à minimiser obtiennent de moins bonnes notes que celles qui le présentent comme un actif stratégique au service de l’impact.

Ce qui a changé pour les programmes de travail 2026-2027

La révision par la Commission européenne, en décembre 2025, des formulaires standards de candidature a introduit plusieurs changements structurels auxquels les grant writers expérimentés sont encore en train de s’adapter. Les limites de pages ont été resserrées pour tous les types d’actions, retirant environ cinq pages d’espace sans supprimer aucune exigence de fond. Les balises obligatoires et certains éléments d’orientation prescriptive ont été retirés du modèle, ce qui peut sembler être un assouplissement mais donne en pratique davantage de marge d’interprétation aux évaluateurs, augmentant le coût de l’imprécision. La section 2.3, le tableau récapitulatif de l’impact, est devenue optionnelle, ce qui constitue un piège : les candidats qui la suppriment perdent souvent la clarté structurelle qu’elle apportait, tandis que ceux qui l’incluent uniquement lorsqu’elle ajoute une véritable clarté obtiennent de meilleures notes.

Le financement en lump sum devrait désormais couvrir environ 50 pour cent des projets Horizon Europe d’ici 2027, ce qui modifie fondamentalement la manière dont les budgets et les work packages sont conçus. Dans le cadre du lump sum, les paiements sont libérés à l’achèvement des work packages plutôt qu’en fonction des coûts réels, ce qui met la pression sur les définitions des work packages dans la proposition. Chaque work package devient un jalon de paiement, de sorte que les frontières des work packages doivent être nettes, les critères d’achèvement explicites et le budget par work package défendable en soi.

Un pilote d’évaluation à l’aveugle a été étendu à certains appels, où la première étape de l’évaluation est réalisée sans que l’identité du consortium soit visible. Des critiques, notamment les observateurs indépendants qui ont suivi les évaluations de la Cancer Mission en 2025, ont soutenu que l’évaluation à l’aveugle affaiblit l’appréciation du track record méthodologique. Il reste à déterminer si ce dispositif sera élargi ou réduit en 2027, mais lorsqu’il s’applique, les propositions doivent communiquer l’excellence sans s’appuyer sur la réputation du coordinateur.

Les priorités stratégiques intégrées aux programmes de travail 2026-2027 ont également évolué. La réduction des Key Strategic Orientations de quatre à trois signale une consolidation autour de la compétitivité, de la sécurité et des transitions verte et numérique jumelles. Les propositions qui recyclent des modèles narratifs de 2021-2024 et un langage d’« impact attendu » provenant de programmes de travail antérieurs sembleront décalées. Les impacts attendus dans chaque Destination de chaque cluster ont été réécrits pour la période actuelle, et les propositions sont censées refléter étroitement ce langage.

L’architecture discrète d’une proposition à très haute note

La proposition Horizon Europe financée ne paraît pas radicalement différente de la proposition rejetée au premier coup d’œil. Les deux feront 40 pages, suivront le modèle, contiendront un diagramme de Gantt, un tableau de consortium et un aperçu du Data Management Plan. Les différences se trouvent dans l’architecture sous la surface.

Une proposition financée est cohérente en interne. Les objectifs de la section 1.1 réapparaissent, reformulés en termes opérationnels, dans les work packages de la section 3.1. Les résultats listés dans le cheminement d’impact correspondent à des livrables précis dans des work packages précis. Les risques de la section 3.1 sont traités par des mitigations qui se retrouvent dans les ressources allouées aux partenaires concernés. Les exigences transversales traversent la méthodologie, le plan de travail et le consortium plutôt que de rester dans des paragraphes boilerplate isolés.

Une proposition financée parle le langage de l’appel. Les outcomes et impacts attendus listés dans le texte de la Destination du programme de travail apparaissent, presque mot pour mot, dans la section Impact de la proposition, puis sont reliés aux résultats spécifiques du projet. Les évaluateurs notent l’adéquation à l’appel, et pas seulement la qualité intrinsèque.

Une proposition financée est écrite d’une seule voix. Les propositions rédigées par consortium, où chaque partenaire écrit sa propre section et où le coordinateur assemble ensuite l’ensemble, sont faciles à repérer et difficiles à très bien noter. Une proposition financée a presque toujours un rédacteur principal unique, parfois le coordinateur, souvent un grant writer dédié, qui reprend les contributions des partenaires et les réécrit dans un récit unifié, avec une terminologie cohérente, une emphase cohérente et une colonne argumentative unique.

Enfin, une proposition financée anticipe la convention de subvention. Chaque jalon, chaque livrable, chaque work package est quelque chose que le consortium a réellement l’intention de livrer et qu’il peut livrer. Une fois la proposition financée, son texte devient la Description of Action annexée à la convention de subvention. Les propositions écrites pour impressionner les évaluateurs mais non pour être exécutées produisent des projets qui peinent dès le premier mois. Les propositions écrites pour être exécutées produisent aussi des projets plus faciles à évaluer, car la logique est la même que celle qui gouvernera les quatre années suivantes de travail. Cet alignement entre persuasion et exécution est le signal le plus fiable d’une proposition finançable, et c’est l’architecture vers laquelle chaque candidat Horizon Europe en 2026 et 2027 devrait construire.